基于人工智能的植物药创新研发平台

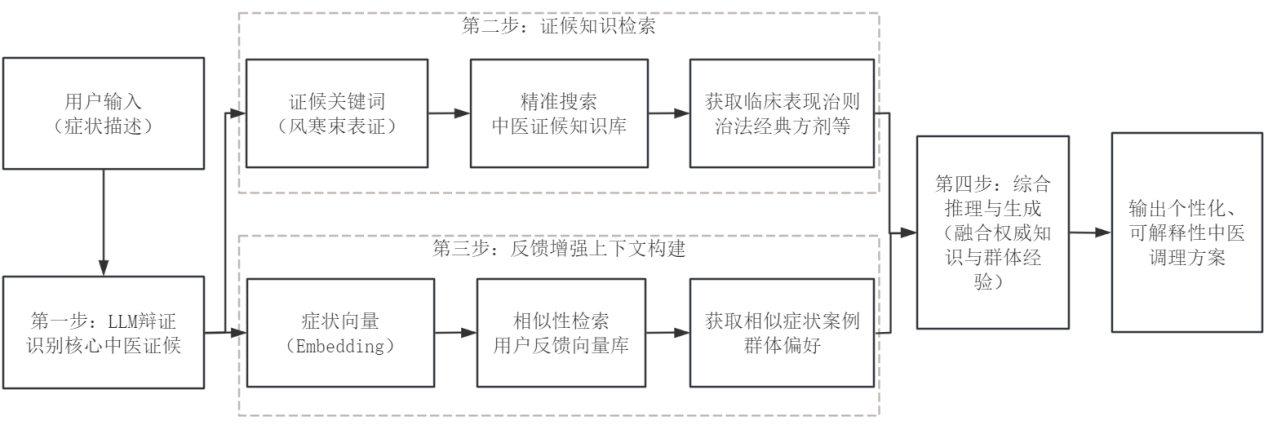

本项目是我们的AI研发团队针对当前植物药研发周期长、机制模糊、活性成分复杂及知识碎片化等核心瓶颈,研究和构建一个融合大模型、检索增强生成(RAG)与微调技术的专属AI创新研发平台。通过系统性整合古籍典籍、现代文献、专利及私有实验数据,结合细胞营养技术和生物发酵技术,构建覆盖“药材–成分–靶点–通路–症候–制剂”全链条的植物药专属知识图谱。在技术架构上,平台采用“大模型+RAG+LoRA微调”三位一体模式:以DeepSeek/Qwen等LLM为基座大模型,利用RAG和向量反馈技术动态注入最新领域知识以提升准确性,并通过专家标注的指令数据集进行LoRA微调,使模型掌握植物药特有的多成分协同作用等复杂推理范式。目前已经初步证明了技术路线的可行性,有望将植物药研发周期从传统的4-6年缩短至1-2年,显著降低研发成本并提升效率。

改进RAG+向量反馈推理引擎

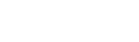

引擎层是一个基于FastAPI构建的高性能服务,其核心工作流如图所示,包含以下关键步骤:

步骤1:LLM辨证分析。 接收用户症状描述后,系统首先利用DeepSeek-Chat LLM进行中医辨证,识别出1-3个最可能的证候。这一步模拟了中医师的辨证思维,为后续精准推荐奠定基础。

步骤2:证候知识检索。 将识别出的证候重排序识别出主要证候,然后将识别出的主要证候编码为向量,在证候知识库中检索相关的中医理论知识,包括该证候的临床表现、治疗原则、常用方药等信息。

步骤3:反馈增强上下文构建。 系统利用BGE-M3对当前症状进行编码,并在PostgreSQL反馈库中执行向量相似度搜索。它会聚合在语义相似症状下获得高评分(如≥8.0)的推荐项作为正向偏好,同时也会识别出普遍低分(如≤3.0)的推荐项作为负向警示,共同构成“用户反馈参考”上下文。

步骤4:LLM推理与生成。 将证候知识摘要和反馈增强上下文一并注入到DeepSeek-Chat LLM[24]的提示词(Prompt)中。LLM根据这些结构化信息,遵循预设的辨证原则(如经典优先、安全第一),最终输出包含辨证分析、推荐理由和具体方药详情的自然语言回答。此过程严格约束了LLM的生成边界,有效缓解了其固有的“幻觉”问题。

引擎层核心工作流

整体技术方案

完整覆盖:从瓶颈→技术→数据→知识→AI→应用→价值的完整链条

三位一体:大模型+RAG+向量反馈+LoRA微调的协同架构

知识全景:覆盖"药材-成分-靶点-通路-症候-制剂"全链条知识图谱

技术融合:AI技术与细胞营养、生物发酵等生物技术深度整合

数据驱动:古籍典籍、现代文献、专利数据、实验数据的多源融合

价值量化:明确的周期缩短、成本降低、效率提升指标

反馈闭环:实验验证反馈驱动模型持续优化

整体技术方案